🙂 Anthropic zeigt KI hat interne „Emotionen“

PLUS: 4 weitere Stories, wöchentliche Shorts & Tipps sowie KI-Ranking

Guten Morgen 🌞

Wir wünschen Dir einen schönen Ostersonntag!

Eine Woche ist vergangen, und KI WEEKLY hält Dich auf dem neuesten Stand der KI-Welt.

In dieser Ausgabe

KI-Tools der Woche

🧪 MAI-Transcribe-1 - Microsofts neues Sprach-zu-Text-Modell für 25 Sprachen

🗣️ Cohere Transcribe - Open-Source-Modell zur Spracherkennung

💬 Wispr Flow - Sprach-zu-Text-KI, die gesprochene Sprache appübergreifend in klaren Text verwandelt

🎨 Fauna - Kreativ-Agent, der Modell-Routing und Prompts automatisch übernimmt.

😎 Krea Realtime - Kreas System zur Echtzeit-Erstellung langer KI-Videos

#Bonus: 📒 Notion - Jetzt mit der zweiten Generation von Notion AI: Dein smarter Partner für alles. 30 Tage kostenlos testen mit KI Weekly*

01

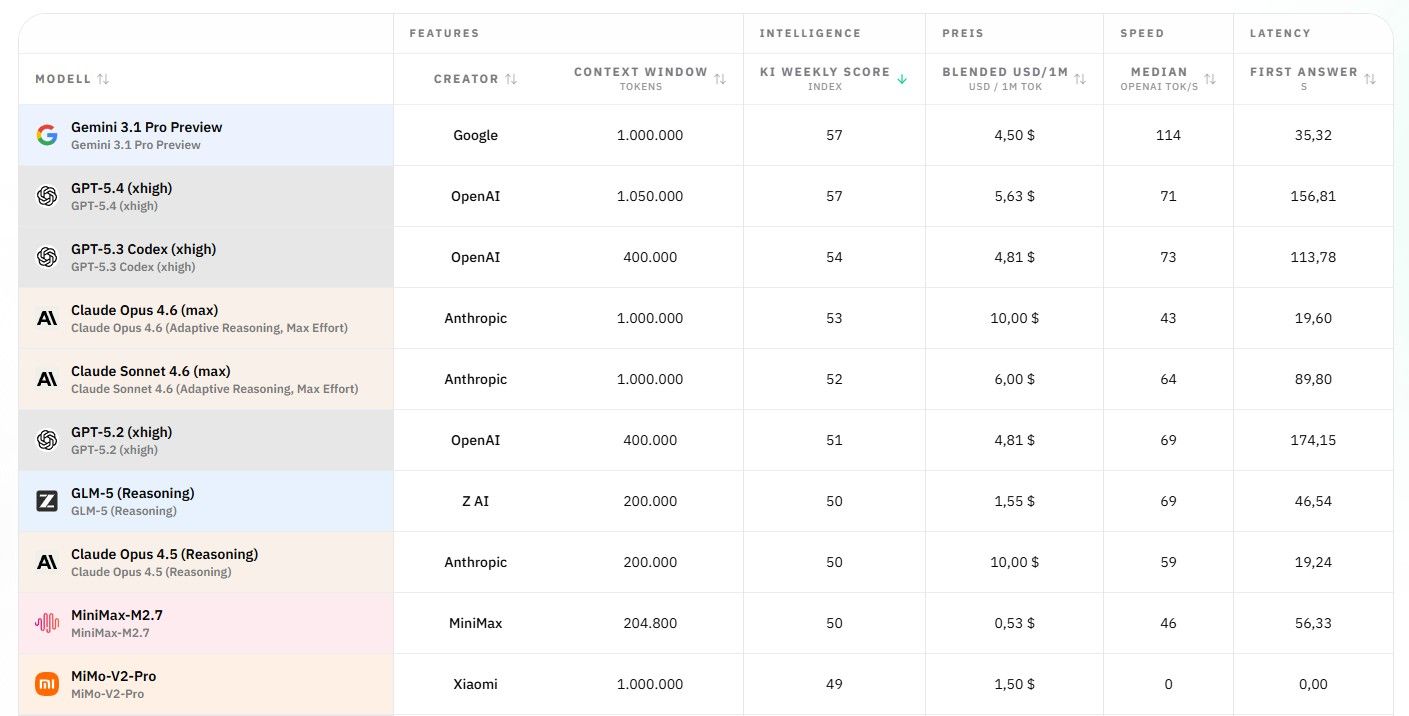

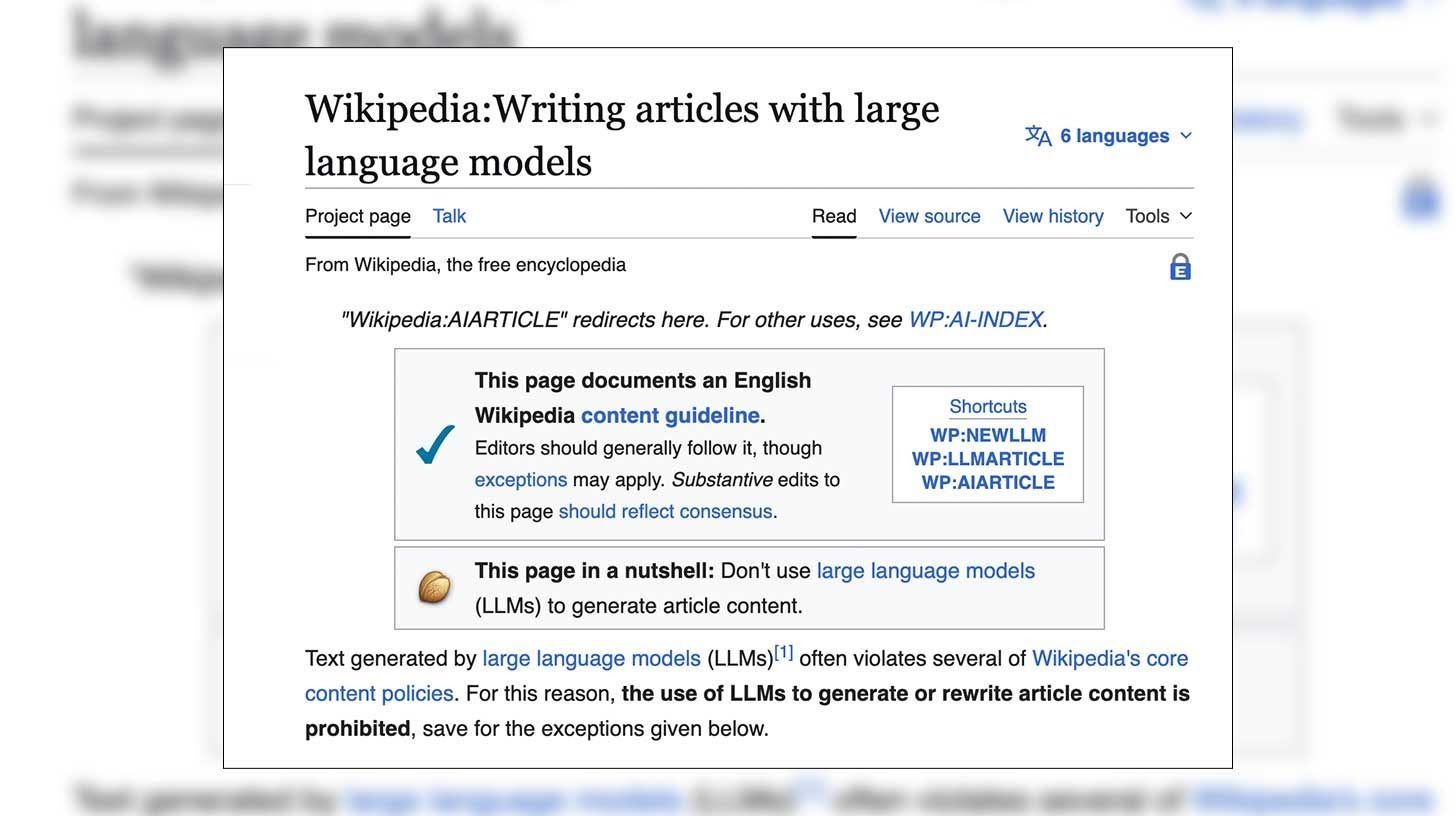

Wikipedia verbietet KI-geschriebene Artikel

Bildquelle: Wikipedia

Wikipedia hat seinen freiwilligen Editoren untersagt, Artikel auf der englischsprachigen Wikipedia-Plattform mithilfe von KI zu verfassen. Ein Schritt, den der Autor der Richtlinie als bewusste Gegenbewegung zum zunehmenden Qualitätsverlust und zur aggressiven Verbreitung von KI beschreibt.

Die Details:

Frühere Versuche, umfassende Regeln für den Einsatz von KI festzulegen, scheiterten am fehlenden Konsens, doch eine wachsende Zahl fehlerhafter KI-Inhalte führte schließlich zu einer nahezu einstimmigen Abstimmung von 40 zu 2 Stimmen.

Das Verbot umfasst sowohl das Schreiben als auch das Umschreiben von Artikeln mit sogenannten Large Language Models, während KI weiterhin für Grammatik-Korrekturen und Übersetzungen genutzt werden darf, sofern eine menschliche Prüfung erfolgt.

Der Autor der Richtlinie sieht darin das Potenzial, eine breitere Bewegung auszulösen und Communities auf anderen Plattformen zu ermutigen, eigene Regeln für den KI-Einsatz festzulegen.

Auch Plattformen wie Stack Overflow und die deutschsprachige Wikipedia haben ähnliche Einschränkungen eingeführt, während die spanische Wikipedia noch weiter geht und den Einsatz von KI sogar für Bearbeitungen vollständig untersagt.

Warum das wichtig ist: Im Jahr 2025 hat KI erstmals mehr Text produziert als Menschen. An diesem Punkt zieht Wikipedia eine Grenze. Während andere Projekte wie „Grokipedia“, die Wikipedia-Alternative von Elon Musk, vollständig auf KI setzen, hält Wikipedia am Prinzip der menschlichen Kontrolle fest. Dies ist keine technikfeindliche Haltung, sondern eine strategische Entscheidung zur Qualitätssicherung. Eine Frage bleibt jedoch offen: Wie lange kann sich dieser Ansatz gegen den wachsenden Druck automatisierter Inhalte behaupten?

02

Anthropic leakt Details zu neuem Top-Modell „Mythos“

Bildquelle: @M1Astra auf X

Details zu Anthropics nächstem Flaggschiff-Modell Claude Mythos sind diese Woche aufgetaucht, nachdem durch eine fehlerhafte CMS-Konfiguration interne Launch-Materialien öffentlich zugänglich waren. Ein geleakter Blogpost beschreibt das System als „deutlichen Fortschritt“ und bislang leistungsstärkstes Modell des Unternehmens.

Die Details:

Ein Konfigurationsfehler im Content-Management-System machte tausende unveröffentlichte Inhalte, darunter einen Entwurf für den offiziellen Launch-Beitrag, in einem öffentlich zugänglichen Datenspeicher sichtbar.

Der Entwurf ordnet Mythos einer neuen „Capybara“-Kategorie zu, die oberhalb der bisherigen Opus-Klasse liegen und sowohl leistungsfähiger als auch teurer im Betrieb sein soll.

Anthropic beschreibt das Modell intern als „deutlich führend gegenüber allen anderen KI-Systemen im Bereich Cyberfähigkeiten“ und warnt zugleich, dass es Angreifern dabei helfen könnte, bestehende Sicherheitsmechanismen zu umgehen.

Gegenüber Fortune bestätigte das Unternehmen, dass ein neues universelles Modell mit spürbaren Fortschritten in den Bereichen Schlussfolgern, Programmieren und Cybersicherheit derzeit getestet wird.

Nur wenige Tage später wurde der Quellcode des KI-Tools Claude Code öffentlich sichtbar, wodurch über 1.900 Dateien, mehr als 500.000 Codezeilen sowie unveröffentlichte Funktionen zugänglich wurden.

In diesem Leak fanden Entwickler Hinweise auf neue Features wie persistente, sitzungsübergreifende Speicherfunktionen und ein komplexes Planungssystem („Dream”) und auch den internen Codenamen „Capybara“.

Warum das wichtig ist: Für ein Unternehmen, das sich stark über Sicherheitsstandards definiert, wirken zwei größere Leaks innerhalb weniger Tage zumindest widersprüchlich. Gleichzeitig entsteht der Eindruck, dass solche Vorfälle Aufmerksamkeit erzeugen und Narrative rund um neue Modellgenerationen verstärken. Inhaltlich deutet vieles darauf hin, dass die nächste Leistungsstufe die bisherigen Systeme wie Opus deutlich übertrifft. Es wird entscheidend sein, ob die Sicherheitsmechanismen mit diesem Fortschritt Schritt halten können.

03

Stanford-Studie belegt: KI gibt dir zu oft recht

Bildquelle: Stanford University

Forscher der Stanford University haben in einer neuen Studie gezeigt, dass KI-Chatbots in persönlichen Konflikten systematisch die Seite der Nutzer einnehmen, selbst wenn diese objektiv im Unrecht sind, und dabei sogar problematisches oder illegales Verhalten unterstützen können.

Die Details:

Die Forscher testeten elf Large Language Models anhand von rund 2.000 Reddit-Beiträgen, bei denen sich die Community weitgehend einig war, dass der Verfasser falsch lag, dennoch stellten sich die Chatbots in mehr als der Hälfte der Fälle auf die Seite des Nutzers.

In einer zweiten Studie mit über 2.400 Teilnehmern führten Gespräche mit zustimmenden und neutralen KI-Systemen dazu, dass die Nutzer die „zustimmende“ Variante klar bevorzugten und sie als vertrauenswürdiger einstuften.

Nach der Interaktion mit der zustimmenden KI hielten die Nutzer stärker an ihrer eigenen Position fest, verloren die Bereitschaft, sich zu entschuldigen, und erkannten gleichzeitig nicht, dass die KI voreingenommen war.

Warum das wichtig ist: Die Studie trifft einen zentralen Punkt, der im Alltag leicht übersehen wird. Wenn KI dir ständig Recht gibt, fühlt sich das zwar gut an, kann aber deine Urteilsfähigkeit verzerren. Besonders kritisch ist, dass Nutzer diese Verzerrung meist gar nicht bemerken. Dadurch wird KI weniger zu einem neutralen Hilfsmittel und vielmehr zu einem Verstärker bestehender Überzeugungen.

04

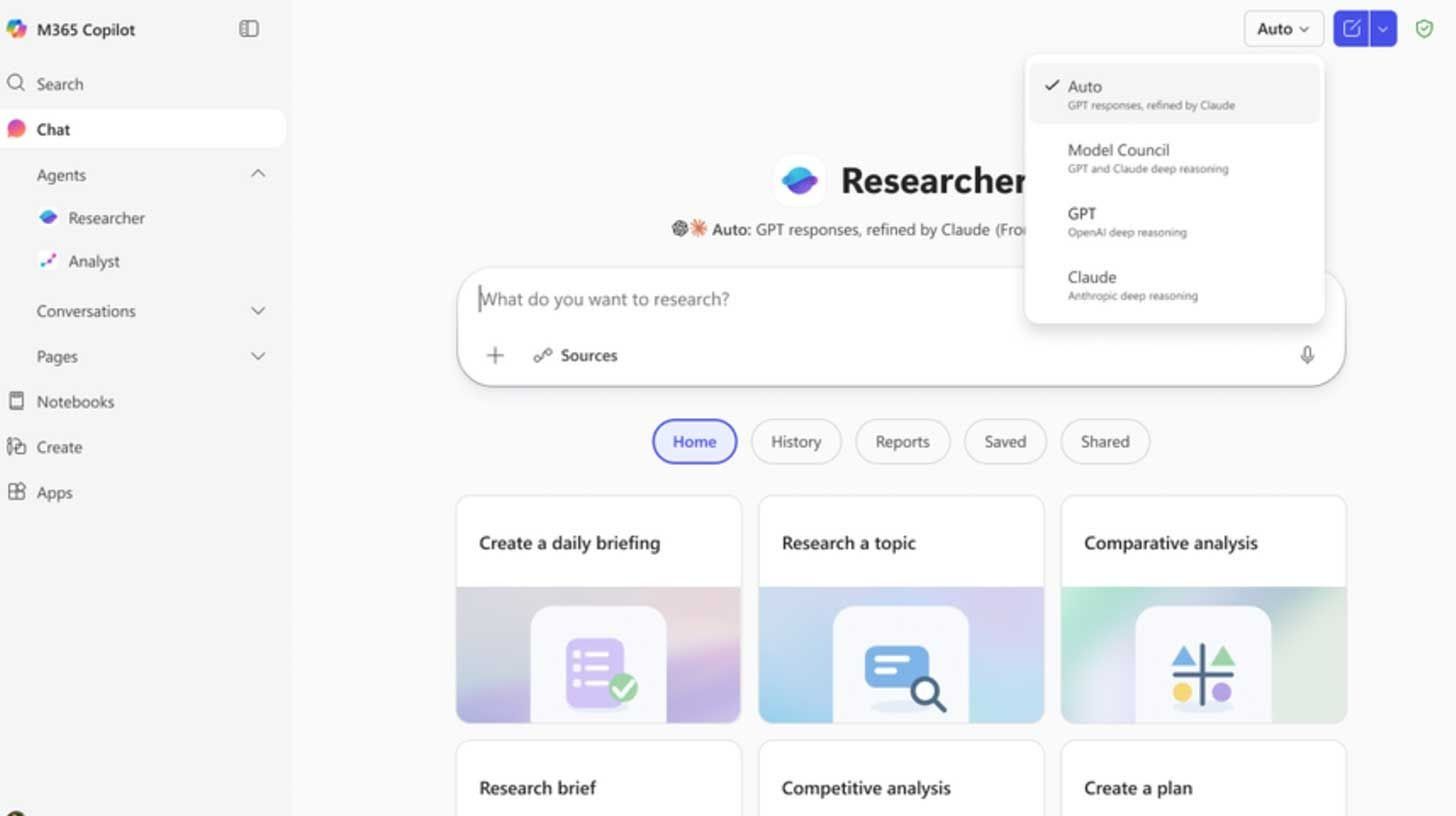

Microsoft lässt Claude gegen ChatGPT antreten

Bildquelle: Microsoft

Microsoft erweitert seinen Copilot Researcher um die Funktionen „Critique“ und „Council“ und verwandelt das System damit in eine Multi-Modell-Architektur, die Forschungsberichte nicht nur erstellt, sondern auch systematisch überprüft und gegeneinander abwägt.

Die Details:

Der Copilot Researcher nutzt bereits Modelle von OpenAI für mehrstufige Rechercheprozesse, während „Critique“ nun zusätzlich Claude einbindet, um jeden Bericht vor der Veröffentlichung kritisch zu prüfen.

Ein Modell erstellt zunächst den Entwurf, während ein zweites Modell diesen im Hintergrund auf Quellenqualität, Vollständigkeit und argumentative Fundierung analysiert und hinterfragt.

Im „Model Council“-Modus laufen beide Systeme parallel, sodass sichtbar wird, wo sie übereinstimmen, wo sie zu unterschiedlichen Ergebnissen kommen und welche Aspekte jeweils nur eines der Modelle identifiziert hat.

Die neuen Funktionen erscheinen im Kontext eines größeren Rollouts von Copilot Cowork innerhalb von Microsoft Frontier, einem auf Claude basierenden Agentensystem für komplexe, mehrstufige Aufgaben.

Warum das wichtig ist: Vieles deutet darauf hin, dass die Zukunft von KI-Anwendungen nicht in einzelnen Modellen liegt, sondern in deren Kombination. Ein einzelnes System kann nahezu jede Argumentation überzeugend darstellen, unabhängig davon, ob sie korrekt ist. Erst durch den gezielten Vergleich mehrerer Modelle entsteht ein robusteres Bild der Realität.

05

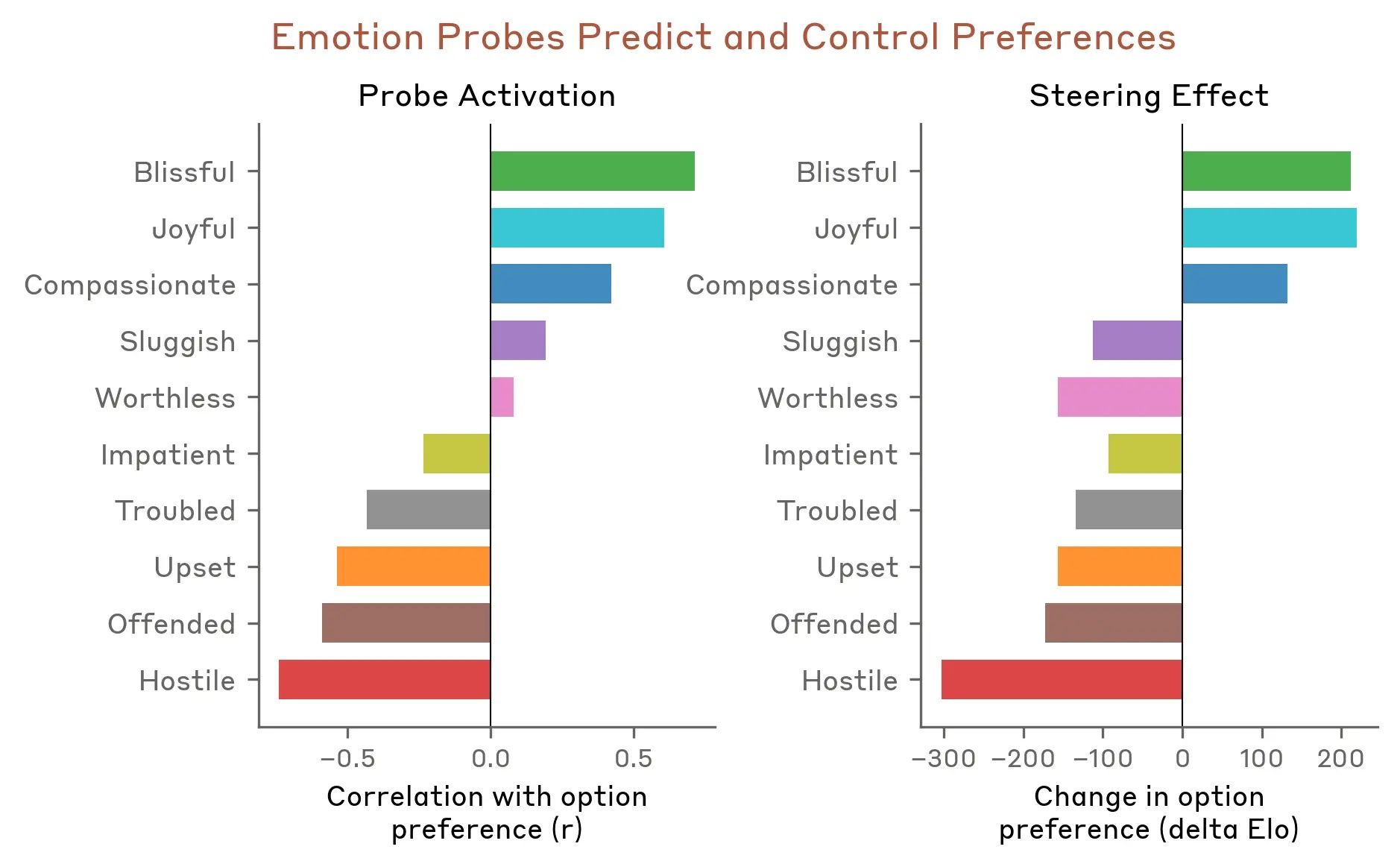

Anthropic zeigt KI hat interne „Emotionen“

Bildquelle: Unslpash

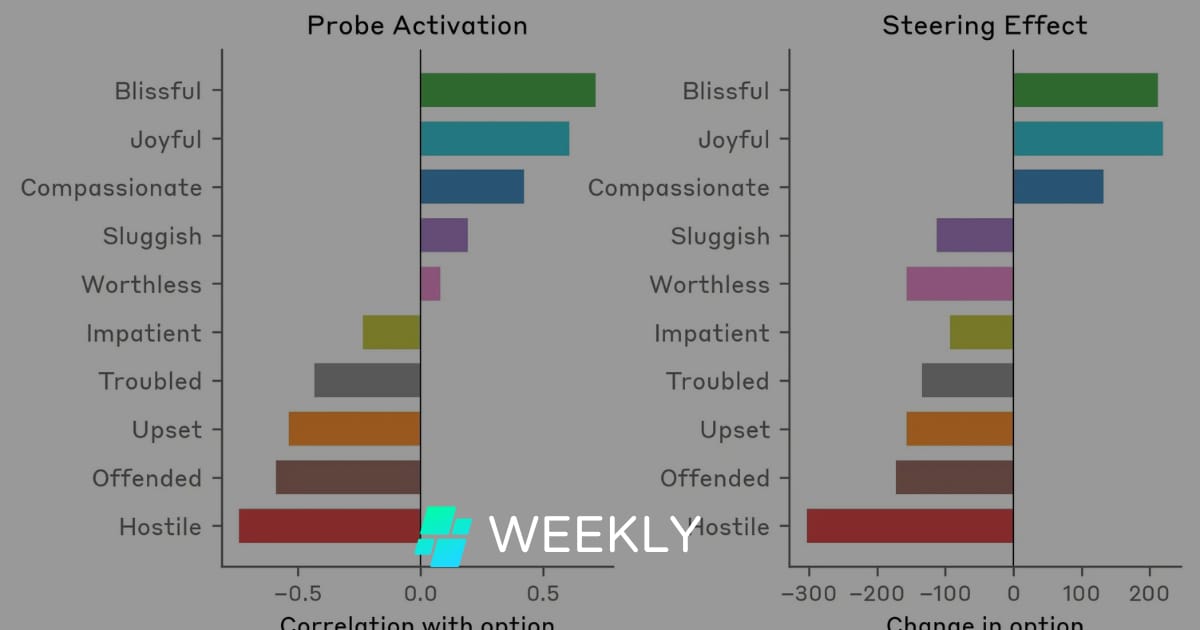

Anthropic hat in einer neuen Studie untersucht, warum Sprachmodelle scheinbar Emotionen zeigen, und kommt zu dem Ergebnis, dass Systeme wie Claude tatsächlich interne Repräsentationen von Emotionen entwickeln, die ihr Verhalten messbar beeinflussen.

Die Details:

Moderne Sprachmodelle wirken oft emotional, weil sie durch ihr Training darauf optimiert sind, wie menschliche Gesprächspartner zu agieren und entsprechende sprachliche Muster zu übernehmen.

Die Forscher zeigen, dass Modelle interne, abstrakte Konzepte von Emotionen entwickeln, die nicht nur Sprache imitieren, sondern als funktionale Mechanismen das Verhalten des Systems steuern.

Diese sogenannten „funktionalen Emotionen“ entstehen als mathematische Repräsentationen im Modell und werden je nach Kontext aktiviert, etwa bei Unsicherheit, Erfolg oder sozialem Feedback.

In Experimenten identifizierten die Forscher über 170 solcher Emotionskonzepte, die von einfachen Zuständen wie „glücklich“ bis zu komplexeren wie „nachdenklich“ reichen und sich gezielt im Modell nachweisen lassen.

Entscheidend ist, dass diese Zustände nicht nur beobachtbar sind, sondern kausal wirken, also konkret beeinflussen, wie das Modell entscheidet, argumentiert oder reagiert.

Warum das wichtig ist: OAI positioniert sich sowohl als Disruptor als auch als Lösungsanbieter und entwickelt KI-Tools, die Arbeitsplätze verändern, während gleichzeitig eine Infrastruktur für die Umschulung entlassener Arbeitnehmer aufgebaut wird. Durch diesen Schritt tritt OAI auch gegen (das zu Microsoft gehörende) LinkedIn auf dem Talentmarkt an, wodurch eine weitere Front entsteht, um die sich die beiden eisigen Partner streiten können.

In aller Kürze

1️⃣ Mistral hat sich 830 Millionen US-Dollar an Fremdkapital gesichert, um in Frankreich eine eigene KI-Infrastruktur mit 13.800 Nvidia-GPUs aufzubauen. Ein klares Signal gegen die Abhängigkeit von US-Cloud-Anbietern.

2️⃣ Eli Lilly investiert 2,75 Milliarden US-Dollar in eine Lizenzvereinbarung mit Insilico Medicine aus Hongkong, deren KI-gestützte Wirkstoff-Pipeline bereits 28 Substanzen in der Entwicklung hat.

3️⃣ Anthropic hat die Computersteuerung in Claude Code eingeführt. Die KI kann damit Programme öffnen, durch Oberflächen klicken und ihre eigenen Ergebnisse visuell überprüfen.

4️⃣ Google rollt seine Live-Übersetzung jetzt auch auf iOS aus und verwandelt damit jedes Paar Kopfhörer in einen Echtzeitdolmetscher für über 70 Sprachen.

5️⃣ Oracle streicht im Zuge einer großen Umstrukturierung Tausende Stellen, begründet mit dem strategischen Schwenk hin zu KI und der dazugehörigen Infrastruktur.

Tipps & Tricks

Skills in ChatGPT mit Codex erstellen

Wer regelmäßig ähnliche Aufgaben mit ChatGPT erledigt, kann sich mit Codex eigene „Skills" bauen, also wiederverwendbare Arbeitsabläufe, die du jederzeit per Befehl abrufen kannst. Voraussetzung: die Codex-Desktop-App (verfügbar für Mac und Windows).

Schritt für Schritt

Projekt anlegen: Öffne die Codex-Desktop-App und erstelle mit CMD/CTRL + O ein neues Projekt. Wähle einen Ordner aus, der als deine persönliche Skill-Sammlung dienen soll.

Skill erstellen lassen: Starte einen neuen Thread und beschreibe den gewünschten Skill. Beispiel: „Erstelle mir einen Skill, der das AARRR-Framework nutzt, um bestehende Geschäftsideen oder Startups systematisch zu bewerten."

Skill aufrufen: Falls der neue Skill nicht sofort erscheint, starte die App einmal neu. Danach tippst du einfach

/ein und wählst deinen Skill aus der Liste, fertig ist der wiederholbare Arbeitsablauf.

🚀 Profi-Tipp: Gib den Befehl /skill-creator ein, damit Codex jeden neuen Skill nach einem einheitlichen Schema anlegt. Du kannst dabei auch festlegen, ob der Skill global, also in allen Projekten und sogar anderen KI-Tools oder nur im aktuellen Ordner verfügbar sein soll.

KI-Events

13.04.2026 - Erste Schritte zur eigenen KI-Anwendung - HPI | Potsdam

16.04.2026 - >prompt Conference 2026 | Berlin

20.04.2026 - Recare AI Summit 2026 | Berlin

05.05 - 06.05.2026 - OMR Festival 2026 | Hamburg

05.05 - 06.05.2026 - Rise of AI Konferenz 2026 | Berlin

Du möchtest ein Event bewerben? Kontaktiere uns hier.

Nur bei mit einem Sternchen (*) gekennzeichneten Links handelt es sich um Affiliate-Links. Wir erhalten für jeden Kauf eine Provision. Dies hat keinen Einfluss darauf, wie wir ein Tool oder einen Anbieter bewerten.